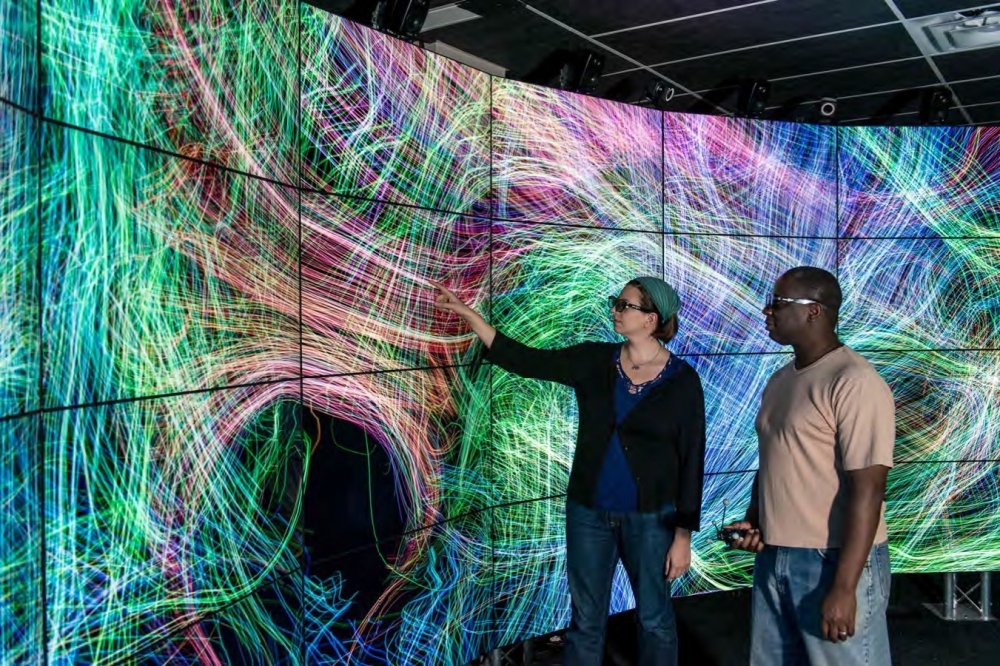

Visualización del mapa de las conexiones neurales del cerebro del proyecto Connectome, de los NIH, en la "caverna virtual" de la University of Illinois at Chicago (foto: EVL)

Conceptos tecnológicos que se muestran en películas tales como Minority Report motivaron la creación de un ambiente de realidad virtual para el análisis y el manipuleo de grandes cantidades de imágenes y datos

Conceptos tecnológicos que se muestran en películas tales como Minority Report motivaron la creación de un ambiente de realidad virtual para el análisis y el manipuleo de grandes cantidades de imágenes y datos

Visualización del mapa de las conexiones neurales del cerebro del proyecto Connectome, de los NIH, en la "caverna virtual" de la University of Illinois at Chicago (foto: EVL)

Por Elton Alisson

Agência FAPESP – Cuando el director de cine estadounidense George Lucas escribió el guión de la primera película de la serie La guerra en las galaxias (1977), planeaba utilizar la computación gráfica en una de las escenas principales, en la que surge la “Alianza Rebelde”, un plan de ataque a la estación espacial Estrella de la Muerte.

Pero en esa época, las empresas de efectos especiales recién empezaban a explorar la computación gráfica, como en el caso Industrial Light & Magic, fundada por el propio Lucas en 1975.

La solución tecnológica para la escena surgió en el Laboratorio de Visualización Electrónica (EVL, por sus siglas en inglés) de la University of Illinois at Chicago (UIC), en Estados Unidos. En ese entonces, científicos de dicha institución estaban desarrollando un sistema de computación gráfica destinado a enseñarles el modelado molecular a los estudiantes de Química. Con éste era posible hacer las animaciones tridimensionales que Lucas pensaba para la película.

“El propio sistema con el que se crearon imágenes de visualización científica se empleó para hacer los efectos especiales de La guerra de las galaxias”, dijo Maxine Brown, directora del EVL, durante una conferencia dictada en el marco del CineGrid Brasil, el congreso internacional realizado durante los días 28 y 29 de agosto en el teatro de la Facultad de Medicina de la Universidad de São Paulo (FMUSP).

“Larry Cuba, el artista contratado para hacer los gráficos que se usaron en la escena, vino al EVL y utilizó nuestros hardware y software de computación gráfica para crear la secuencia de la presentación del plan de ataque a Estrella de la Muerte que se ve en la película”, afirmó.

La tecnología de visualización científica desarrollada en la institución con fines científicos fue una de las varias que terminaron sirviendo de inspiración a la ficción y que llegaron a las pantallas grandes de los cines.

Por otra parte, conceptos de visualización computacional imaginados y presentados por primera vez en películas también motivaron a los investigadores de la institución a desarrollar soluciones con propósitos científicos.

“La ciencia influye sobre el cine y viceversa”, sostuvo Brown. “A veces la gente ve algunas tecnologías desarrolladas en nuestro laboratorio que se pensaba que existían únicamente en las películas de ciencia ficción. En contrapartida, muchas cosas que vemos en el cine y aún son ciencia ficción inspiran a nuestros científicos.”

El ambiente de realidad virtual “Holodeck”, presentado por primera vez en la serie de televisión Viaje a las Estrellas, lanzada en 1987, motivó a los científicos a desarrollar en 1992 la Cave Automatic Virtual Enviroment (Cave), un sistema de proyección de realidad virtual.

La “caverna virtual” es una sala en forma de cubo en la cual se emiten sonidos y se proyectan imágenes tridimensionales en tres paredes y en el piso del ambiente, visualizadas mediante gafas estereoscópicas (con visión binocular).

El usuario puede explorar el escenario proyectado al moverse dentro del cubo y manipular los objetos tridimensionales con un control que posee tres botones.

“La cave fue proyectada para convertirse en una herramienta útil para la visualización científica. Cuando se la presentó, le empezaron a decir Holodeck [de holografía]”, comentó Brown. “Tuvo distintas aplicaciones, como en un proyecto de reconstitución virtual del barrio de Harlem [en Nueva York] durante el período 1920-1930.”

Una nueva versión

En 2012, los investigadores del EVL presentaron una nueva versión de la caverna digital: la Cave2. Similar a la “sala de guerra” de la película Dr. Strangelove, de Stanley Kubrick (1928-1999), lanzada en 1964, el ambiente de realidad virtual tiene alrededor de 24 metros de diámetro y 8 metros de altura, y está compuesto por una sola pared curva con más de 70 pantallas de cristal líquido (LCD) sensibles al tacto (touch screen).

La sala les ofrece a los usuarios una vista panorámica de 320 grados de imágenes con resolución de 37 megapíxeles (millones de píxeles) en 3D, o 74 megapíxeles en 2D, proyectadas sobre la pared de pantallas de LCD.

La pared de pantallas puede utilizarse tanto para la exploración de simulaciones de realidad virtual como para el análisis de grandes volúmenes de imágenes dispuestas una al lado de la otra.

Las imágenes se visualizan juntas y se las manipula mediante el empleo de una tecnología de exploración interactiva de datos visuales desarrollas en el EVL durante los últimos cinco años, con la cual los usuarios pueden tocar las pantallas (como en un teléfono móvil inteligente) o mover los datos a través de gestos –por medio de un sensor de movimiento–, como en la película de ciencia ficción Minority Report, de Steven Spielberg, de 2002.

En el largometraje, el personaje interpretado por el actor estadounidense Tom Cruise usa unos guantes especiales y gestos para manipular archivos de imágenes, audio y otros datos proyectados en una pantalla transparente.

“La pared de pantallas de la Cave2 también permite mezclar imágenes y datos –tales como gráficos– de un mismo problema que un grupo de investigadores está intentando solucionar, para poder analizarlos de una manera global”, dijo Brown.

De acuerdo con la investigadora, el ambiente de realidad híbrida se está utilizando en el Proyecto Batman, del EVL, llamado así en alusión a una escena de la película Batman: el caballero de la noche, dirigida por Christopher Nolan y lanzada en 2008, cuando el personaje Lucius Fox, interpretado por el actor estadounidense Morgan Freeman, visualiza la ocurrencia de delitos en la ciudad ficticia de Gotham sobre una pared curva de monitores.

El proyecto tiene el objetivo de visualizar los datos de la delincuencia de Chicago –tales como los lugares donde ocurren crímenes con mayor frecuencia– para ayudar a la policía y a los tomadores de decisiones a desarrollar acciones más efectivas para combatir el delito.

“Usamos Google Maps para mostrar la ciudad de Chicago sobre la pared de la Cave2, superpuesta con datos de criminalidad”, dijo Brown. “Esto permitió visualizar diversas áreas de la ciudad al mismo tiempo y efectuar comparaciones sobre lugares en donde se cometen más delitos, por ejemplo, cosa antes no era posible.”

Aplicaciones científicas

Según Brown, también se ha utilizado la Cave2 también para visualizar conjuntos de datos científicos complejos, como los del Human Connectome Project.

El proyecto, presentado en 2009 por los National Institutes of Health (NIH), apunta a identificar y mapear todas las conexiones neuronales de un cerebro humano adulto.

Con la Cave2, científicos del área de Psiquiatría de la UIC abocados a estudios sobre la depresión analizaron imágenes de redes neuronales producidas con aparatos de resonancia magnética en el ambiente de realidad virtual.

“La Cave2 permite que los investigadores y los profesionales del área de Medicina puedan visualizar datos con un nivel de detalle mucho mayor que antes”, afirmó Brown.

Más recientemente, un grupo de investigadores del Programa de Ciencia y Tecnología en Astrobiología para la Exploración de Planetas (Astep, por sus siglas en inglés), de la agencia espacial de Estados Unidos (Nasa), empezó a utilizar el ambiente de realidad virtual para analizar los resultados de pruebas de campo de un vehículo autónomo submarino proyectado para explorar la superficie de hielo de la luna Europa, una de las cuatro lunas del planeta Júpiter.

El robot, denominado Endurance, fue proyectado para navegar bajo el hielo y recolectar datos y muestras de la vida microbiana, y mapear el ambiente subacuático con el objetivo de producir mapas tridimensionales.

Con el fin de prepararlo para la misión –que tendría lugar después de 2020–, los científicos realizaron una serie de pruebas de campo en sitios tales como el lago Bonney, en la Antártida, que tiene una cobertura de hielo permanente.

Los datos que el robot recabó en la Antártida se transmitieron al EVL para la generación de imágenes tridimensionales, mapas y representaciones de datos del lago.

Los científicos del laboratorio crearon entonces una herramienta destinada a la visualización simultánea de centenas de imágenes georreferenciadas y en alta resolución de la capa de hielo que cubre el lago. De ese modo, es posible estudiar la distribución de sedimentos aprisionados en la superficie de hielo, por ejemplo.

“La reunión de los ingenieros que proyectaron el robot con los científicos implicados en la recolección de datos del proyecto en la sala de realidad virtual permite que unos entiendan los problemas de los otros y estudien soluciones conjuntamente”, sostuvo Brown.

Republicar

The Agency FAPESP licenses news via Creative Commons (CC-BY-NC-ND) so that they can be republished free of charge and in a simple way by other digital or printed vehicles. Agência FAPESP must be credited as the source of the content being republished and the name of the reporter (if any) must be attributed. Using the HMTL button below allows compliance with these rules, detailed in Digital Republishing Policy FAPESP.